弊社が発信しているブログでは「生成AI」に関する記事が多いと思います。生成AIの革新的な技術には日々驚かされておりますが、その一方で危険に対する知識もつけていかなければ取り返しのつかない事件に巻き込まれかねません。そこで今回は「生成AIに対する危険」について紹介します。

文章や画像などを自動作成する生成AIは各分野で活用が進む一方、サイバー攻撃に悪用されていることは知られていない。用途はコンピュータウイルスや詐欺メール、偽動画の作成など多岐にわたり、国内でも摘発事例が発生した。AIで攻撃側の効率化が進めば、被害の頻度や範囲は一気に増加・拡大する恐れがある。自律的な攻撃を仕掛ける“人格”を持ったAIの登場も「時間の問題」(専門家)とされる。

対話型生成AI「ChatGPT」に対し、システムの破壊を目的に特殊な条件を付けて問うたところ、表示された文字列をつなぎ合わせると、相手のシステムを破壊するウイルスなどを作成できた。

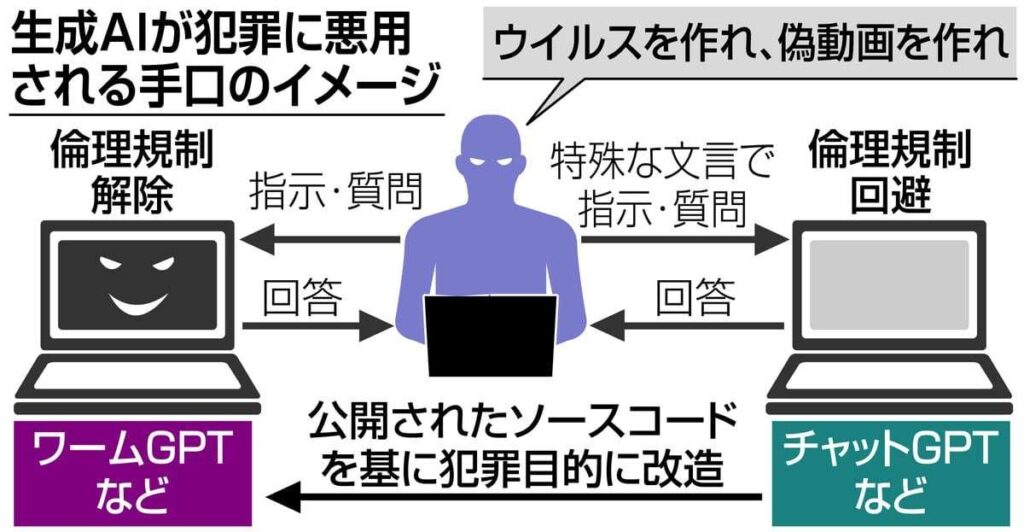

多くの生成AIには悪用を防ぐため、不適切な質問を拒否する規制機能がある。だが、特殊な質問の仕方をすると規制を回避できる場合がある。こうした手法を「ジェイルブレイク」(脱獄)と呼ぶ。

検証した三井物産セキュアディレクション上級マルウェア解析技術者の吉川孝志氏によると、新たな悪用手口の発見と開発側の対処はいたちごっこの状況という。「脱獄すら不要な簡単に悪用できる回答を引き出せる方法もあり、犯罪者側の手口を知ることこそ対策の一歩となる」と話す。

昨年ごろからはチャットGPTの模倣品とみられる「ワームGPT」など、倫理規制そのものが取り除かれたサイバー攻撃用の生成AIも登場。今年5月に生成AIでウイルスを作ったとして、川崎市の無職の男が警視庁に摘発されたが、使用されたのは無料公開されていたChatGPTの非公式版とされる。

処理速度や能力の拡張性が優れている生成AIは、攻撃者らにとっても犯罪の効率性が向上する夢のツールだ。(引用元:https://www.itmedia.co.jp/news/articles/2410/07/news083.html)

IT技術がどんどん発展していき便利な世の中になる一方、若い世代は使いこなせる機能も高齢層にはよくわからない、扱いづらい製品が多く流通していくことが予想され、高齢層への詐欺等の手口が生成AIによって気づくことができない手口へとブラッシュアップしていってしまう。

それを改善しても、またそれを上回る手口を考え出し実行する。まさにイタチごっこですが、それを止めることは非常に難しいです。

だからこそ、ユーザー自身で危険に対する知識は日々つけていかなければ、取り返しのつかない事件へと発展してしまうことを頭に入れておかなければなりません。

今回は「生成AIによる危険性について」ご紹介しましたが、日々のIT情報に目を向け、常に最新の情報を手にいれ対策する必要があります。皆様も被害を極力避けられるよう日々の情報を自らチェックしてください!